コラムカテゴリー:AI, ITコンサルティング, セキュリティ

記事の執筆

尾塚 賢太

新卒で中堅・中小企業のコーポレートIT支援会社に入社。基幹システム・販売管理システムの導入やシステム運用、ヘルプデスクを経験する。 全社最適を目指したIT活用の支援を行いたく、青山システムコンサルティングに入社。前職から培った第三者視点で企画から運用までを意識したコンサルティングを行っている。

はじめに

生成AIの業務利用が普及しつつある中で、導入の検討が難航している企業は多いのではないでしょうか。

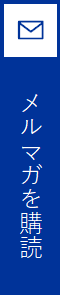

独立行政法人情報処理推進機構のデータ(*1)によると、生成AIを利用・許可していない・利用予定なしと回答した人のうち25%は「セキュリティや安全性のリスク」を懸念事項として挙げています。また、生成AIを利用している・利用予定と回答した人でも、60%は「セキュリティ」に脅威を感じています。

*1 独立行政法人情報処理推進機構 セキュリティセンター.”AI利用時のセキュリティ脅威・リスク調査 調査報告書”. 2024年7月4日.https://www.ipa.go.jp/security/reports/technicalwatch/eid2eo00000022sn-att/report.pdf(参照:2026年2月3日)

これらのデータを踏まえると、セキュリティの壁にぶつかりながらも、具体的な対策の検討や対応が後手に回っている現状が見えてきます。本コラムでは、セキュリティ対策を例示しながら、生成AIのセキュリティリスクとの向き合い方を考察します。

<Youtube版はこちら>

生成AIのセキュリティリスクとは

まずは、どのようなリスクへの対策が必要かを把握するために、生成AIの利用による代表的なセキュリティリスクを「意図的脅威」と「偶発的脅威」で分類し紹介します。

1.意図的脅威

悪意を持ったサイバー攻撃や物理的攻撃といった脅威が該当します。

-

- プロンプトインジェクション:生成AIに誤作動を起こさせるプロンプト(指令)を与え、不適切な回答や出力を禁止している情報を開示させる攻撃

- データポイズニング:偏ったデータや誤ったデータを生成AIの学習に混入させ、誤情報を出力させる攻撃

- 偶発的脅威

不注意や人為的ミスによる脅威が該当します。

-

- 機密情報の入力による情報漏えい:生成AIに入力した機密情報が学習に利用され、出力データに機密情報が混じること

- シャドーAI:会社が利用を許可していない生成AIを利用すること

このようにリスクを整理してみると、生成AIならではのリスクが増え、新しい視点での対策が必要と感じるかもしれません。しかし、「どこを守るべきか」に着目すると、これまで直面してきたセキュリティリスク対策の延長線上にあると分かります。

意図的脅威であれば、サイバー攻撃である以上、侵入を防ぐために堅牢なセキュリティ対策をしているAIサービスを選定することが重要です。また、偶発的脅威についても、情報の取り扱いルールを策定し、厳守してもらう仕組みを構築します。この対応だけでも、多くのリスクを未然に防ぐことができます。

つまり、今まで積み重ねてきたルールや環境を生成AIにも拡げていくことをまずは着手してみてください。

セキュリティリスクへの対策

入口対策・内部対策・出口対策の枠組みで、生成AIへのセキュリティ対策を例示します。

- 入口対策

入口対策では、サイバー攻撃や不正利用を防ぐことを目的として、信頼できるAIサービスを選定するために、以下の2点の機能の有無を確認することが必要です。

- 入力データの学習防止

入力データが生成AIの学習に利用されない「オプトアウト」が機能として備わっていること。これにより、自社の機密情報が出力データとして漏えいするリスクを排除できます。

- ログの取得

従来の「いつ・誰がアクセスしたか」という記録に加え、「入力データ(プロンプト)と出力データ」のログも取得できること。機密情報の入力の抑止力となるだけでなく、インシデント発生時の対応にも必要不可欠な情報となります。

「個人アカウント」はセキュリティ機能を組織的に制御できないため、サービス選定の選択肢にはなり得ません。また、「シャドーAI」を根絶するには、ルール化だけでなく、会社から法人アカウントを適切に配布し、安全な利用環境を用意することが最優先事項です。

- 入力データの学習防止

- 内部対策

内部対策では生成AIを安全に活用してもらうことを目的として、AIガイドラインの作成とシステムによる権限管理及び入出力の制限の設定を行います。

①AIガイドラインの作成

ガイドラインは以下のような項目を盛り込みます。-

- 利用可能な生成AIサービス

利用を許可するサービスを限定し、「個人アカウント」の業務利用を明確に禁じることは、生成AI導入における最低限のセキュリティラインです。

- 利用ルール

利用目的や対象業務など利用開始する際のルールから、利用できる機能や利用方法を制限することで、情報漏えいのリスクを低減できます。

- 入力可能なデータの範囲

入力可能なデータの種類を具体的に提示することで、利用者の判断に寄らない活用ができます。

- 出力データの取り扱い

出力データの妥当性を判断する責任者を明確にしましょう。これにより、最終的には人間が確認すべきであるという意識が定着します。

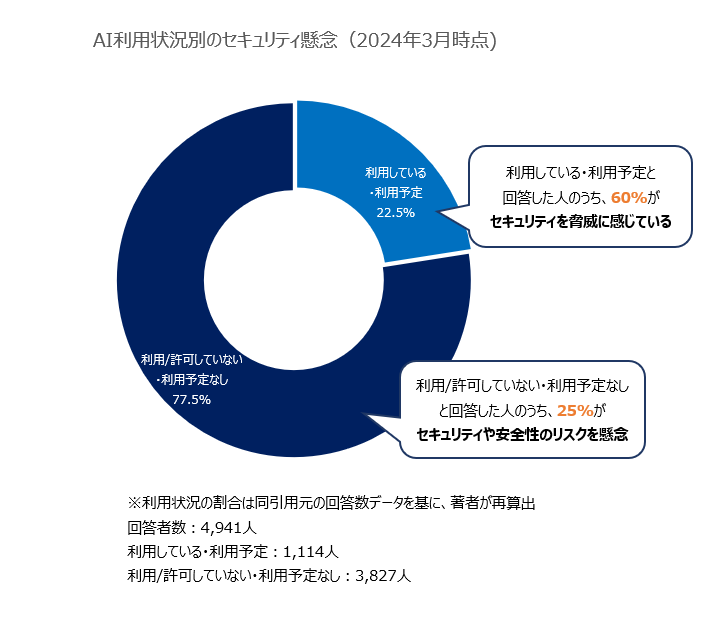

一例として入力データの取り扱いを決める方法をご紹介します。ここでは、情報資産の機密性に合わせて分類し、具体的に入力可能なデータを示します。

例えば、情報資産ごとに以下の表のように3つに分類していたとき、BとCの情報までなら入力を許可するといった具合に、具体的に定義することで、迷うことなく活用していくことができます。

また、これらをガイドラインとして整備するだけでなく、定期的な研修を実施することで、セキュリティ意識を高め、リスクの低減につながります。

- 利用可能な生成AIサービス

②ガイドラインに沿った設定

ガイドラインをユーザーに遵守してもらいつつ、そもそもガイドラインから外れた対応をできない状態を作ることが重要です。上記で示したガイドラインをもとに2点設定を行います。-

- 権限管理

「利用ルール」をもとに対象部署や役職に応じた権限を付与します。権限の設計時は最小権限の原則に従い、必要最低限に抑えます。このとき、生成AIサービスだけでなく、社内の学習元データも権限管理を忘れずに行ってください。

- 入力や出力の制限

入力や出力データでブラックリストを作成し、「個人情報」や「契約情報」など禁止しているワードを使用できないよう制限します。また、ユーザーが入力したプロンプトを検証するためのプロンプトを管理者側で用意することで、入力内容が不正かどうかの判断を行うことができます。

- 権限管理

-

- 出口対策

出口対策では不正利用の検出や情報漏えい等のトラブル時の対応のため、ログを取得し、監視します。ログは以下のような項目を記録すると良いでしょう。

-

- ユーザー:誰が利用したか

- 入力データ:ユーザーが入力したプロンプト

- 出力データ:生成AIからの回答

- 利用日時:処理日時

ブラックリストのワードが出現していないか、大量データの出力や短時間で大量のプロンプトが投げられていないかなど不自然な利用をしていないかを定期的にチェックします。

どこまでセキュリティ対策を講じるか

ご紹介した対策だけでは、リスクをゼロにすることは不可能です。また、リソースは限られるため、すべてのリスクに対し一律に堅牢な対策を実施することも現実的ではありません。そこで、注力すべき範囲を明らかにするために、リスクベースアプローチを用いて、リソース配分を決めます。

- リスクベースアプローチによる評価

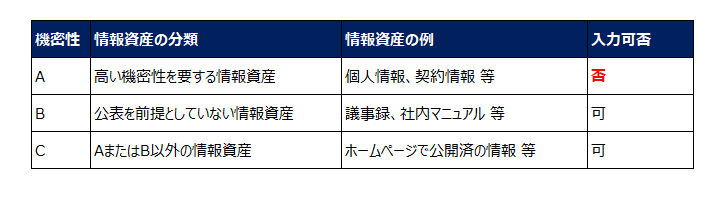

スクベースアプローチとは重要度と被害発生可能性の掛け合わせにより、リスクを算定し、リスクに合わせた適切な対策を講じる考え方です。情報資産を以下の図(*2)のように、リスクの重みづけを行うことで、重点箇所を明確にすることできます。

*2 独立行政法人情報処理推進機構 セキュリティセンター.”中小企業の 情報セキュリティ対策 ガイドライン 第3.1版”. 2023年4月26日.https://www.ipa.go.jp/security/guide/sme/ug65p90000019cbk-att/000055520.pdf(参照:2026年2月3日)

リスクベースアプローチは効率的にセキュリティ対策を進めることができますが、「守り」を意識するあまり、利便性を損なう可能性があります。「禁止」ではなく、成果や効率を求めて「安全に利用してもらう」ことが目的です。そのため、経営層や利用ユーザーの声を聞き、バランスのとれたセキュリティ対策設計と継続したルールの見直しを行うべきです。

まとめ

ルールを制定しない中で生成AIが利用できてしまうセキュリティリスクを考えると、段階的で良いのでルールを決めていく必要があります。まずは、整備されているセキュリティ対策を生成AIに適用していき、生成AI特有のリスクや社内の業務に合わせ拡張や更新をしていく意識を持つことが重要です。

関連サービス

2026年02月20日 (金)

青山システムコンサルティング株式会社